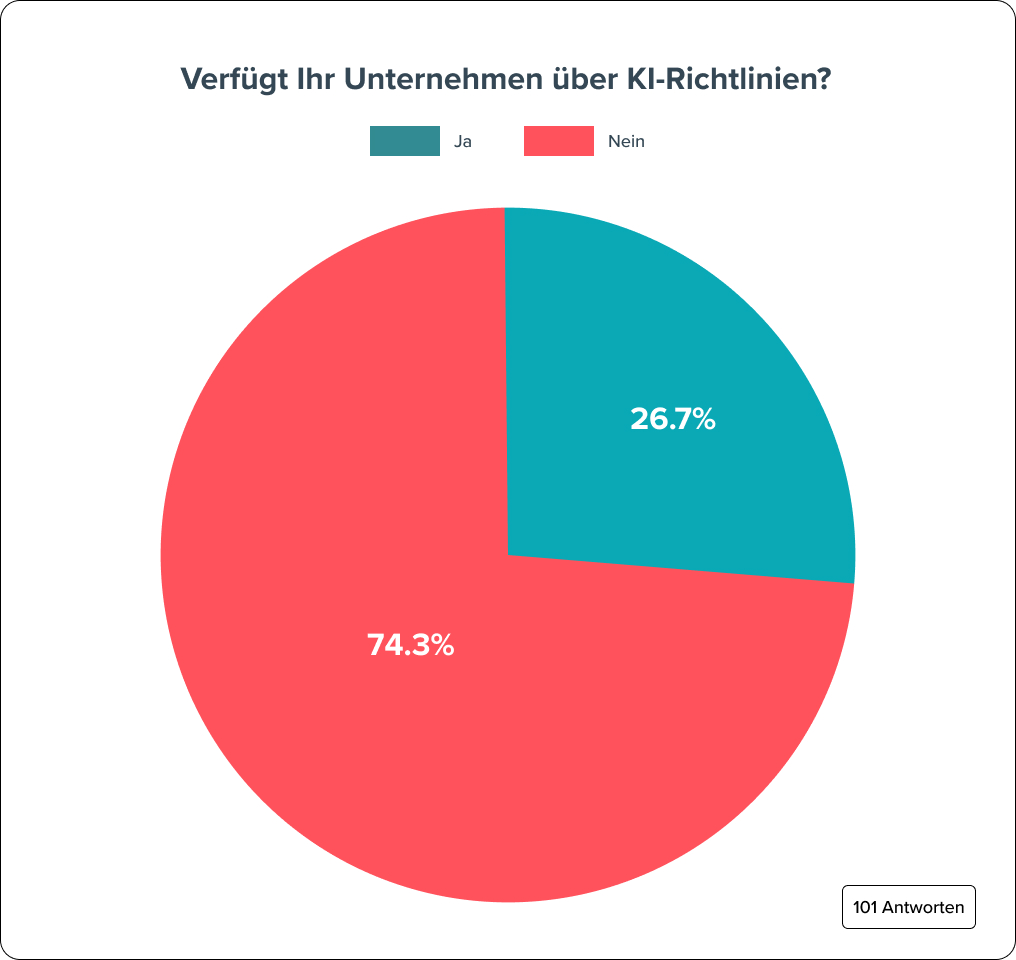

Künstliche Intelligenz verändert Marketing und Geschäftsabläufe, doch die Ergebnisse unserer KI-Umfrage offenbaren eine überraschende Lücke: Die Mehrheit der Befragten, die KI im Marketing einsetzen, verfügen über keine formellen Richtlinien. In diesem Artikel beleuchten wir, wer tatsächlich KI-Richtlinien in verschiedenen Branchen, Ländern und Größenordnungen einsetzt, und untersuchen, inwiefern diese Trends allgemeine Herausforderungen im Bereich der KI-Governance widerspiegeln könnten.

Dabei wird deutlich: Während in vielen Teilen der Welt der Mangel an klaren gesetzlichen Vorgaben Unsicherheit schafft, stehen Unternehmen im EU-Raum bereits unter erheblichem Regulierungsdruck. Zwar nahmen an unserer Umfrage mehrheitlich Werbefachleute aus den USA und dem Vereinigten Königreich statt; allerdings muss man auch deren Unsicherheiten im Kontext des erheblichen Regulierungsdrucks sehen, den Unternehmen im EU-Raum bereits erfahren.

Gerade in diesem Spannungsfeld – zwischen regulatorischer Leere in manchen Regionen und komplexen Anforderungen in anderen – zeigt sich, wie unterschiedlich die Unsicherheiten bei der Einführung von KI ausfallen können. Unternehmen müssen daher nicht nur mit technologischen Entwicklungen Schritt halten, sondern auch sicherstellen, dass ihre internen Richtlinien den jeweiligen regulatorischen Realitäten standhalten.

Wer nutzt KI-Richtlinien?

Erstaunliche 73 % der Befragten, die KI in ihren Marketing-Prozessen einsetzen, gaben an, dass ihr Unternehmen über keine Richtlinie zur Nutzungsregelung verfügt. Und diese Daten spiegeln einen breiteren Branchentrend wider. Eine ähnliche Studie von Traliant hat beispielsweise ergeben, dass nur 60 % der Unternehmen über eine KI-„Acceptable Use Policy“ (AUP) verfügen. Dabei haben 31 % der Personalverantwortlichen keine Richtlinien für die ordnungsgemäße Nutzung von KI mitgeteilt. Darüber hinaus berichtet Security Magazine, dass 10 % der Unternehmen über eine umfassende formelle Richtlinie verfügen und mehr als 1 von 4 Unternehmen angibt, dass es in ihrem Unternehmen keine entsprechende Regelung gibt – und dass auch kein Plan für eine solche besteht.

Die Lücke in der Regulierung wirft Fragen darüber auf, wie Marken mit Risiken und Chancen in diesem Bereich umgehen. Wie wirkt sich der Stillstand in der KI-Politik nun genau auf bestimmte Unternehmen aus? Schlüsseln wir es nach firmenbezogenen Trends auf:

Branchen

Die Branchen mit den meisten Befragten, die über eine funktionierende und aktive KI- Richtlinie berichten, sind folgende:

- Marketing und Medien (45 %)

- Dienstleistungen für Unternehmen (42 %)

In Anbetracht der Tatsache, dass diese Sektoren auch die größten Nutzer von KI sind, können wir auf zwei Dinge schließen: Entweder sind diese Branchen von Natur aus proaktiver bei der Umsetzung von KI-Richtlinien, oder aber der Bedarf an strukturierten Richtlinien steigt mit der zunehmenden Integration der KI-Nutzung in den Geschäftsbetrieb.

Diese Daten deuten auf eine direkte Korrelation zwischen der Verbreitung von KI und dem Schwerpunkt auf der Entwicklung von Richtlinien hin, was die Notwendigkeit von Standards in Branchen mit hoher Nutzung unterstreicht.

Subscribe to

The Content Marketer

Get weekly insights, advice and opinions about all things digital marketing.

Thanks for subscribing! Keep an eye out for a Welcome email from us shortly. If you don’t see it come through, check your spam folder and mark the email as „not spam.“

Länder

Das Land mit der höchsten Anzahl an Befragten, die eine KI-Richtlinie in ihrem Unternehmen einführten, war das Vereinigte Königreich. 29 % gaben an, dass sie eine KI-Richtlinie am Arbeitsplatz verwenden.

Die größte Gruppe der Befragten kam aus den Vereinigten Staaten, doch lag ihre Umsetzung von Richtlinien (26 %) leicht unter dem Durchschnitt (27 %). Die anderen Länder schnitten wie folgt ab:

- Australien: Einer von acht Befragten gab an, eine KI-Richtlinie zu haben.

- Neuseeland und Kanada: Keiner der Befragten (drei bzw. zwei) verfügte über eine KI-Richtlinie.

- Pakistan: Der eine Befragte, der angab, KI im Marketing einzusetzen, verfügt über eine KI-Richtlinie.**

Verbreitet haben wir die Umfrage über unsere eigenen Marketing-Kanäle – unter anderem in unserem Newsletter. Zusätzlich baten wir alle Mitarbeitenden, sie in ihren sozialen Netzwerken zu teilen, um eine möglichst breite Teilnahme zu erzielen.

Während die Branchendaten darauf hindeuten, dass eine höhere KI-Nutzung einen größeren Bedarf an Richtlinien nach sich zieht, zeigen die Erkenntnisse auf Länderebene ein differenzierteres Bild. So hinken die USA – obwohl sie der größte Nutzer sind – bei der Einführung von Richtlinien im Vergleich zu Großbritannien leicht hinterher, was darauf hindeutet, dass Faktoren wie das regulatorische Umfeld, die Unternehmenskultur und die Marktreife bei der Gestaltung der KI-Governance ebenfalls eine Rolle spielen können.

Unternehmensgröße

Unternehmen mit 501 oder mehr Beschäftigten (38 %) und solche mit 51 bis 500 Beschäftigten (35 %) wiesen den höchsten Prozentsatz an KI-Richtlinien auf. Unsere Umfrage ergab, dass größere Unternehmen mit größerer Wahrscheinlichkeit über eine KI-Richtlinie verfügen. Diese Ergebnisse spiegeln sich auch im 2024 AI C-Suite Report von Littler wider, aus dem hervorgeht, dass von den Unternehmen mit mehr als 5 000 Mitarbeitern 80 % über eine generative KI-Richtlinie verfügen (63 %) oder eine solche in Arbeit ist (17 %). Dies ist wahrscheinlich auf die höhere Risikoexposition und die Ressourcen großer Unternehmen zurückzuführen. Das bedeutet jedoch nicht, dass der Trend linear verläuft.

Unsere Umfrage ergab, dass zwar größere Unternehmen am ehesten über eine KI-Richtlinie verfügen, kleinere Unternehmen (21 %) jedoch am zweithäufigsten und mittelgroße Unternehmen am seltensten (8 %). Dies könnte ein Spannungsverhältnis zwischen der Verfügbarkeit von Ressourcen und der Risikobereitschaft widerspiegeln.

(Hinweis zur Kategorisierung: Die Größenangaben basieren auf der von Teilnehmenden angegebenen Mitarbeiterzahl – einer gängigen Metrik in der amerikanischen Marktanalyse. Neben unterschiedlichen lokalen Rechtssystemen bleibt hier also zu bedenken, dass die Kategorisierung nicht direkt den in Deutschland üblichen Geschäftskategorien entspricht. So sind etwa “kleinere Unternehmen” nicht mit den steuerlichen Unternehmensformen der Kleinunternehmerregelung gleichzusetzen.

Nach Beschäftigungsmodell

Unternehmen, die KI-Richtlinien mit Remote- Arbeitskräften umsetzen, führen die Liste an (41 %). An zweiter Stelle stehen Unternehmen mit einer hybriden Struktur (22 %), gefolgt von Unternehmen mit Beschäftigten, die im Büro anwesend sind (12 %).

Dies deutet auf eine direkte Korrelation zwischen Cloud-basierten Operationen und dem wahrgenommenen Bedarf an KI-Richtlinien hin. Auch wenn diese Daten einen Zusammenhang vermuten lassen, bedeutet dies nicht, dass Unternehmen, die vom Büro aus arbeiten, keinen tatsächlichen Bedarf an internen KI-Richtlinien haben.

Ein Blick auf KI-Richtlinien auf der Landkarte

Angesichts der Tatsache, dass nur sehr wenige Unternehmen unternehmensweite KI-Richtlinien erlassen haben, überrascht es nicht, dass die (bestehenden oder in Entwicklung befindlichen) KI-Richtlinien sich auch von Land zu Land stark unterscheiden.

Einige Länder haben umfassende, rechtsverbindliche Rahmenregelungen entwickelt, während andere eher unverbindliche Leitlinien vorgeben. Auch der Grad der Präzisierung – ob KI-Nutzung auf detaillierter Ebene oder durch allgemeine Richtlinien geregelt wird – unterscheidet sich. Und das wirkt sich möglicherweise auf die Art und Weise aus, wie Unternehmen KI verantwortungsvoll entwickeln und einsetzen. Hier ein kleiner Vorgeschmack auf das, was Sie finden könnten:

- Gesetzlich bindende vs. unverbindliche Richtlinien: Einige Regionen haben rechtlich verbindliche Vorschriften zur Entwicklung und Nutzung von KI erlassen, während andere Empfehlungen mit begrenzten Durchsetzungsmechanismen anbieten.

- Umfang der Richtlinie: Einige Richtlinien enthalten detaillierte Anweisungen zur Implementierung und Nutzung von KI in Unternehmen. Andere verfolgen einen breiteren Ansatz, indem sie allgemeine Grundsätze für eine verantwortungsvolle KI-Entwicklung aufzeigen.

- Schwerpunktbereiche: Die Richtlinien können sich darauf konzentrieren, wie Unternehmen KI-Technologien nutzen und implementieren sollten, wobei ethische Überlegungen im Vordergrund stehen, oder sie können den Schwerpunkt auf verantwortungsvolle Entwicklungspraktiken legen, um nachteilige soziale Auswirkungen wie die Verdrängung von Arbeitsplätzen zu verhindern.

Hier ist eine Übersicht der Fortschritte der einzelnen Regionen bei der Entwicklung entsprechender Richtlinien:

- Vereinigte Staaten: Zwar erließ die Biden-Regierung 2023 eine Exekutivverordnung über die sichere und vertrauenswürdige Entwicklung und Nutzung künstlicher Intelligenz. Allerdings hat US-Präsident Trump diese gleich im Januar wieder außer Kraft gesetzt.

- Kanada: Die Richtlinie zur automatisierten Entscheidungsfindung bietet einen Rahmen für den verantwortungsvollen Einsatz von KI in kanadischen Bundeseinrichtungen. Diese Richtlinie ist detaillierter und verbindlicher als breitere, auf Grundsätzen basierende Richtlinien.

- Australien: Die australische Agentur für digitale Transformation hat politische Leitlinien und Schulungsressourcen veröffentlicht, um die verantwortungsvolle Einführung von KI in der Verwaltung zu unterstützen. Diese Ressourcen dienen eher der Bewusstseinsbildung als der Auferlegung strenger rechtlicher Verpflichtungen.

- Neuseeland: Neuseeland hat ein Rahmenwerk für den öffentlichen Dienst für KI entwickelt, das Leitlinien für die ethische und sichere Nutzung von KI im öffentlichen Sektor enthält. Dieses Rahmenwerk bietet Grundsätze und Leitlinien und keine rechtsverbindlichen Vorschriften.

- OECD: Die KI-Grundsätze dienen als globale Referenz und ermutigen die Mitgliedsländer zur Umsetzung einer Politik, die sichere und faire KI-Systeme gewährleistet. Die OECD-Grundsätze sind zwar einflussreich, aber nicht bindend.

Europäische Union und Deutschland

Die Europäische Union hat mit dem AI Act den weltweit ersten umfassenden und rechtsverbindlichen Rahmen für KI geschaffen. Dieses Gesetz gilt für Anbieter und Nutzer*innen von KI-Systemen innerhalb der EU, aber auch für Unternehmen außerhalb, deren Systeme oder Ergebnisse in der EU genutzt werden.

Es verfolgt einen risikobasierten Ansatz: Je höher das potenzielle Risiko eines KI-Systems für Gesundheit, Sicherheit oder Grundrechte ist, desto strenger sind die Auflagen.

Praktiken mit inakzeptablem Risiko (z. B. Social-Scoring, bestimmte Formen biometrischer Überwachung, manipulative Techniken) sind gänzlich verboten, wobei diese Verbote ab Februar 2025 schrittweise in Kraft treten.

Sogenannte Hochrisiko-Systeme, die häufig in Bereichen wie Personalwesen (z. B. Recruiting), kritischer Infrastruktur oder Strafverfolgung eingesetzt werden, unterliegen strengen Anforderungen bezüglich Risiko-Management, Datenqualität und Governance, technischer Dokumentation, Protokollierung, Transparenz, menschlicher Aufsicht und Cybersicherheit.

Anbieter müssen Konformitätsbewertungen durchführen und Systeme teils in einer EU-Datenbank registrieren.

Regulierung generativer KI über den AI Act hinaus

Auch Allzweck-KI-Modelle wie generative KI müssen Transparenzpflichten erfüllen (z. B. Kennzeichnung von KI-generierten Inhalten, Offenlegung von Trainingsdaten). Für generative KI-Modelle mit systemischem Risiko gelten zusätzliche Pflichten wie Modellbewertungen und Risikominimierung.

Zudem ist die Einhaltung der Datenschutz-Grundverordnung (DSGVO) bei der Verarbeitung personenbezogener Daten durch KI unerlässlich.

Auch wenn Deutschland also kein eigenes, spezifisches KI-Gesetz hat, müssen Unternehmen mit bestehenden Regulierungen vertraut sein und auch Entwicklungen, wie die des Allgemeinen Gleichbehandlungsgesetzes, im Blick behalten. Freilich bleibt für alle deutschen Unternehmen auch das Betriebsverfassungsgesetz (BetrVG), das Betriebsräten Mitspracherechte bei der Einführung von KI einräumt, Dreh- und Angelpunkt vieler Entscheidungen.

Bußgelder und rechtliche Konsequenzen bei Missachtung

- Der AI Act sieht Bußgelder von bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes vor.

- Verstöße gegen die DSGVO können mit bis zu 20 Millionen Euro oder 4 % des weltweiten Jahresumsatzes geahndet werden, wobei in Deutschland bereits Bußgelder im Millionenbereich für unrechtmäßige Datenverarbeitung oder mangelnde Transparenz bei automatisierten Entscheidungen verhängt wurden.

- Verstöße gegen das AGG (Diskriminierung) führen zwar nicht primär zu behördlichen Bußgeldern, können aber zu Schadensersatz- und Entschädigungsforderungen durch Betroffene führen, die mehrere Monatsgehälter betragen können.

Die unterschiedlichen regulatorischen Ansätze weltweit führen zu Unsicherheiten bei der KI-Integrierung. Während die detaillierte und strenge Regulierung durch den EU AI Act für einige Unternehmen in Deutschland und Europa zu Bedenken hinsichtlich Innovationsgeschwindigkeit und Implementierungskomplexität führt, schafft die weniger umfassende föderale Regulierung in den USA Unsicherheiten bezüglich zukünftiger Haftungsrisiken und ethischer Standards. Beide Szenarien – hohe wie auch (noch) geringere Regulierung – beeinflussen die Risikobewertung und die Adoptionsbereitschaft von KI in Unternehmen maßgeblich.

Bestehende und neu entstehende KI-bezogene Risiken auf dem Markt können die Produktivität eines Unternehmens bereits gefährden. Die Entwicklung von Standards hilft Ihnen, diese Risiken zu antizipieren und sich darauf vorzubereiten, um potenziell schlimme Folgen abzumildern. Was taucht also in den KI-Richtlinien der Marketing-Fachleute auf?

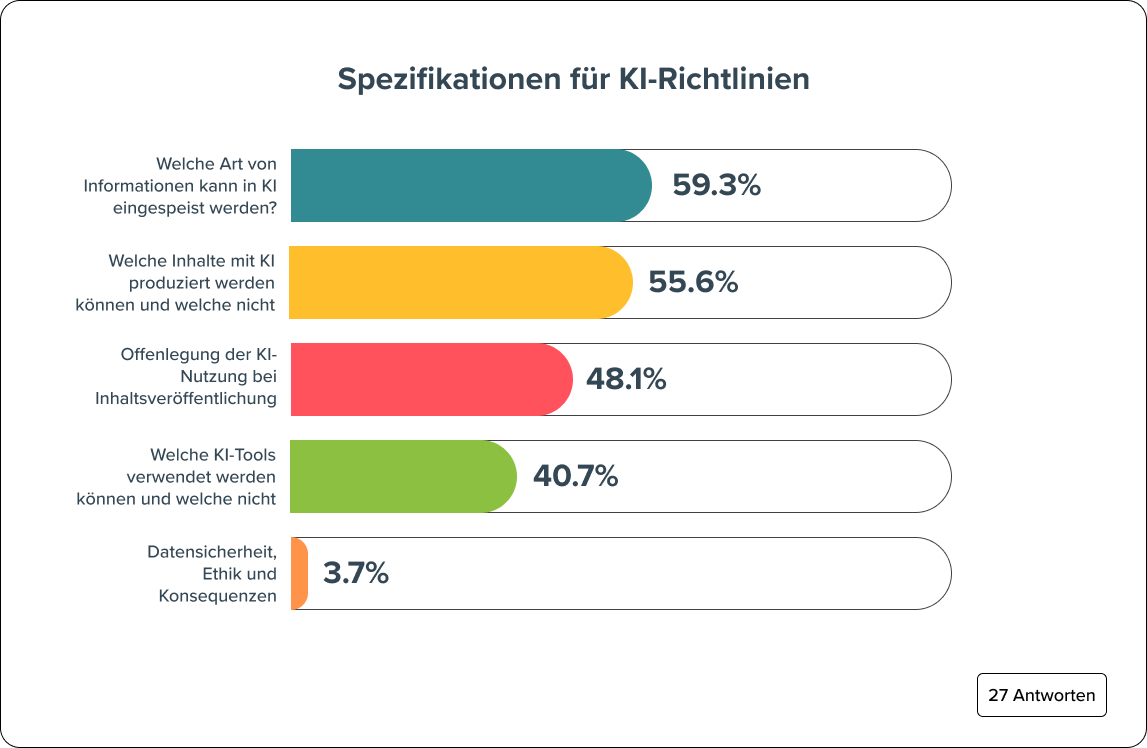

Was beinhalten KI-Richtlinien?

Unternehmen, die über Richtlinien verfügen, schaffen eine solide Grundlage für Governance, um potenzielle Risiken in ihrem Unternehmen zu mindern. Zugegeben, die Zahl der Antworten auf unsere Umfrage ist begrenzt, da nur wenige Unternehmen KI-Richtlinien eingeführt haben.

Was beinhalten KI-Richtlinien?

Unternehmen, die über Richtlinien verfügen, schaffen eine solide Grundlage für Governance, um potenzielle Risiken in ihrem Unternehmen zu mindern. Zugegeben, die Zahl der Antworten auf unsere Umfrage ist begrenzt, da nur wenige Unternehmen KI-Richtlinien eingeführt haben.

Im globalen Vergleich sehen wir nach wie vor große Unterschiede in der Integrierung und Regulierung von KI. Im deutschen Markt tätige Unternehmen sehen sich mit einer sehr spezifischen und bereits fortgeschrittenen Regulierung konfrontiert, maßgeblich geprägt durch EU-Vorgaben. Der Eckpfeiler ist die EU-KI-Verordnung (oder EU AI Act), die als einer der weltweit ersten umfassenden Rechtsrahmen speziell für künstliche Intelligenz gilt.

Wichtig: Der EU AI Act gilt nicht nur für Unternehmen mit Sitz in der EU, sondern auch für solche, deren KI-Systeme mit EU-Bürgern und -Bürgerinnen interagieren. Diese Verordnung verfolgt einen risikobasierten Ansatz. Das bedeutet, die Verpflichtungen zur Einhaltung der Vorschriften werden strenger, je höher das potenzielle Risiko eines KI-Systems ist.

Wenn Sie darüber nachdenken, eine solche für sich selbst zu erstellen, sollten Sie die folgenden Komponenten berücksichtigen:

| Richtlinien-Baustein | Anforderungen |

| Anwendungsbereich und Zweck | Klare Definition des Anwendungsbereichs der Richtlinie, der erfassten KI-Systeme, der betroffenen Nutzergruppen und der verfolgten Ziele (z. B. Innovationsförderung bei gleichzeitiger Risikominimierung). |

| Prinzipien und Werte | Verankerung der Unternehmenswerte im Umgang mit KI, Sicherstellung eines ethischen, menschenzentrierten Ansatzes und Ausrichtung an fundamentalen Werten wie Fairness und Autonomie. |

| Regulatorische Compliance | Strikte Einhaltung aller relevanten gesetzlichen Rahmenbedingungen, insbesondere des EU AI Acts (Risikoklassifizierung, spezifische Pflichten für Hochrisiko-Systeme, Transparenzgebote, verbotene Praktiken), der DSGVO, des AGG (Diskriminierungsverbot) sowie potenzieller Mitbestimmungsrechte nach BetrVG. |

| Datensicherheit und Datenschutz | Gewährleistung der Vertraulichkeit, Integrität und Verfügbarkeit von Daten gemäß DSGVO und AI Act (bei Hochrisiko-Systemen). Schutz von Geschäftsgeheimnissen und geistigem Eigentum durch klare Regeln zur Dateneingabe in KI-Tools (insbesondere externe). Umsetzung der DSGVO-Grundsätze wie Datenminimierung, Zweckbindung und Speicherbegrenzung bei der Verarbeitung personenbezogener Daten durch KI. |

| Bias und Fairness | Aktive Vermeidung von Diskriminierung gemäß AGG durch Identifizierung und Minderung von Bias in KI-Algorithmen und Trainingsdaten, insbesondere bei Systemen im Personalwesen oder mit Kundenkontakt. Sicherstellung fairer und nachvollziehbarer Ergebnisse. |

| Transparenz und Nachvollziehbarkeit | Umsetzung der Transparenzanforderungen des EU AI Acts (z. B. Kennzeichnung von KI-generierten Inhalten, Information bei Interaktion mit KI-Systemen). Sicherstellung der Erklärbarkeit von KI-Entscheidungen, insbesondere bei Hochrisiko-Systemen. Definition zulässiger KI-Anwendungsfälle, genehmigter Tools und des Umgangs mit KI-generierten Ergebnissen (inkl. Offenlegungspflichten). |

| Rechenschaftspflicht und Aufsicht | Klare Zuweisung von Verantwortlichkeiten für die Einhaltung der Richtlinie, die Überwachung von KI-Systemen und das Risiko-Management. Implementierung von Mechanismen zur menschlichen Aufsicht, wo vom AI Act gefordert (v. a. bei Hochrisiko-Systemen). Einrichtung von Prozessen für Meldungen von Verstößen/Problemen, regelmäßige Audits und die Aktualisierung der Richtlinie. Berücksichtigung der Informations- und Konsultationsrechte des Betriebsrats (BetrVG). |

| Ethik und Grundrechte | Verpflichtung zur Achtung der Menschenwürde und der Grundrechte bei Entwicklung und Einsatz von KI. Sicherstellung, dass KI dem Menschen dient und keine unverhältnismäßigen Risiken für Individuen oder Gesellschaft schafft. |

Beachten Sie, dass die Richtlinien der einzelnen Unternehmen je nach Art der verwendeten Tools und dem Umfang der KI-Arbeiten leicht unterschiedlich aussehen werden.

Helfen KI-Richtlinien, die Einführung zu vereinfachen?

Auf unsere Frage, ob KI-Richtlinien die Einführung von KI erleichtern, gab es nur 14 Antworten – ein Hinweis darauf, wie wenige Unternehmen über formale Rahmenwerke verfügen. Die Hälfte (7/14) gab jedoch an, dass sich dies positiv auf die Einführung von KI auswirkt. Hier sind einige der Antworten:

Wie hat sich die KI-Richtlinie auf die Einführung von KI in Ihrem Unternehmen ausgewirkt?

- „Sie hat das Angebot des Unternehmens transparenter gemacht, und die Kundschaft weiß, was sie erwarten kann.“

- „Sie hat dazu beigetragen, die Erwartungen unserer Kundschaft und potenzieller Partner*innen zu erfüllen.“

- „Die Produktionszeit wurde leicht verkürzt, aber es werden immer noch Menschen für die Verfeinerung der Inhalte benötigt.“

- „Hat sie nicht.“

- „ Sie fördert den Einsatz von KI.“

- „Es ist noch zu früh, um das zu beurteilen.“

- „Nicht dramatisch, aber sie beschreibt vor allem bewährte Verfahren.“

Ein Befragter äußerte auch Bedenken hinsichtlich der Fähigkeit von generativer KI, marken- und rechtskonforme Inhalte zu produzieren:

„Es entspricht nicht den Markenstandards und den rechtlichen Erwägungen/Richtlinien.“

Auch wenn unsere kleine Stichprobe keine endgültigen Schlussfolgerungen zulässt, deuten die Antworten auf ein breiteres Muster hin, das in ergänzenden Untersuchungen beobachtet wurde. So fand der Littler-Bericht heraus, dass fast 85 % der Personalverantwortlichen über Rechtsstreitigkeiten im Zusammenhang mit prädiktiver oder generativer KI besorgt sind und 73 % den Einsatz von KI aufgrund der regulatorischen Unsicherheit zurückfahren.

Eine klare, umfassende KI-Richtlinie bietet interne Orientierungshilfe und kann auch als Instrument zur Risikominderung dienen, indem sie rechtliche und regulatorische Unklarheiten beseitigt. Durch die Festlegung definierter Parameter für den Einsatz von KI können sich Unternehmen vor potenziellen Rechtsstreitigkeiten schützen und gleichzeitig einen zuversichtlicheren, proaktiven Ansatz bei der Einführung pflegen.

Tipps für die Erstellung von KI-Richtlinien, die eine verantwortungsvolle KI-Einführung unterstützen

- Beziehen Sie funktionsübergreifende Interessengruppen ein: Holen Sie nicht nur Beiträge aus IT-, Rechts- und Personalabteilung ein, sondern binden Sie von Beginn an den Betriebsrat aktiv ein. Die Einführung und Anwendung von KI-Systemen, insbesondere wenn sie potenziell Leistung oder Verhalten von Mitarbeitenden überwachen können, unterliegt oft der zwingenden Mitbestimmung nach § 87 Abs. 1 Nr. 6 Betriebsverfassungsgesetz (BetrVG). Auch Informations- und Beratungsrechte (§ 90 BetrVG) sowie Mitbestimmungsrechte bei Auswahlrichtlinien (§ 95 BetrVG) können relevant sein. Eine partnerschaftliche Entwicklung fördert die Akzeptanz und vermeidet spätere Konflikte. Erwägen Sie, die finalen Regelungen in einer Betriebsvereinbarung festzuhalten.

- Gestalten Sie die Richtlinien flexibel, aber verbindlich: Formulieren Sie die Regeln verständlich und praxisnah. Planen Sie aber auch regelmäßige Überprüfungen und Anpassungen ein, da sich sowohl die KI-Technologie als auch die rechtlichen Rahmenbedingungen schnell weiterentwickeln. Flexibilität darf jedoch nicht zulasten der notwendigen Verbindlichkeit gehen, gerade bei mitbestimmungspflichtigen Inhalten.

- Integrieren Sie Maßnahmen zum Risiko-Management: Berücksichtigen Sie neben Datenschutz (DSGVO), Bias-Minimierung (AGG-Konformität) und rechtlicher Compliance (EU AI Act) auch die betriebsverfassungsrechtlichen Aspekte (BetrVG). Definieren Sie klare Prozesse zum Umgang mit Risiken und zur Meldung von Problemen.

- Investieren Sie in transparente Kommunikation und Schulungen: Führen Sie verständliche Schulungsprogramme zur Funktionsweise der eingesetzten KI und zu den Inhalten der Richtlinie durch. Stellen Sie sicher, dass alle – von der Geschäftsführung bis zu den Mitarbeitenden – die Regeln und den verantwortungsvollen Umgang mit KI im Arbeitsalltag verstehen. Regelmäßige Updates sind unerlässlich.

- Planen Sie für den Fall von Meinungsverschiedenheiten: Da viele Aspekte der KI-Einführung der Mitbestimmung unterliegen, kann es bei Verhandlungen mit dem Betriebsrat zu unterschiedlichen Auffassungen kommen. Eine frühzeitige, offene Kommunikation kann helfen, Konflikte zu vermeiden. Sollte dennoch keine Einigung erzielt werden, kann für mitbestimmungspflichtige Themen die Einigungsstelle angerufen werden, um eine verbindliche Entscheidung herbeizuführen (§ 76 BetrVG).

Wann werden sich KI-Richtlinien am Arbeitsplatz durchsetzen?

Während die Dynamik bei der Einführung von KI auch in Deutschland spürbar ist – laut Destatis nutzte Ende 2024 bereits jedes fünfte Unternehmen (20 %) KI, ein deutlicher Anstieg gegenüber dem Vorjahr – hinkt die Entwicklung formaler Richtlinien oft noch hinterher.

Eine Umfrage von Deloitte vom September 2024 ergab, dass sich fast die Hälfte (48,6 %) der deutschen Unternehmen noch nicht intensiv mit der Vorbereitung auf den EU AI Act beschäftigt hatte. Nur rund ein Drittel (35,7 %) fühlte sich gut auf die Umsetzung der neuen Vorgaben vorbereitet, und konkrete Maßnahmen wie die Einrichtung einer Taskforce (7,5 %) oder die Zuweisung an eine Abteilung (9,1 %) waren noch selten. Dies spiegelt wider, dass viele Unternehmen zwar den Bedarf erkennen, aber die Umsetzung strukturierter Richtlinien aufgrund von Unsicherheiten bezüglich der Regulierung und mangelndem Wissen noch zögerlich angehen.

Viele Unternehmen sehen das KI-Risiko-Management daher eher als zukünftige Herausforderung denn als aktuelle Notwendigkeit an, was möglicherweise auf die sich entwickelnde Natur der KI-Technologie und die Komplexität der regulatorischen Rahmenbedingungen zurückzuführen ist. Da Unternehmen jedoch immer stärker auf KI angewiesen sind, ist eine allmähliche Verlagerung hin zu einer umfassenderen Umsetzung von Richtlinien am Arbeitsplatz zu erwarten.

Einer unserer Befragten erwähnte, dass „[KI-Richtlinien] die Nutzung einschränken, da KI-generierte Inhalte in einigen Formaten nicht akzeptiert werden“, was unterstreicht, wie wichtig es ist, Standards zu schaffen, die eine zuverlässige Regulierung ermöglichen, ohne das kreative Potenzial Ihres Marketing-Teams einzuschränken.

Machen Sie Ihre KI-Strategie mit klaren Richtlinien zukunftssicher

Unsere Daten zeigen, dass es zwar Lücken gibt, dass aber Unternehmen, die gezielte KI-Richtlinien einführen, davon erheblich profitieren können. Eine gut durchdachte KI-Richtlinie kann rechtliche und betriebliche Risiken mindern und eine Kultur der Transparenz und Verantwortlichkeit fördern, die es den Teams ermöglicht, innovativ zu sein und KI-Lösungen vertrauensvoll einzusetzen.

Da die Industrie zunehmend auf KI setzt, können sich Unternehmen mit proaktiven Richtlinien einen Wettbewerbsvorteil verschaffen und Vertrauen bei den Stakeholdern aufbauen. Da KI immer mehr zu einem integralen Bestandteil von Geschäftsfunktionen wird, wird der Ruf nach expliziten, umfassenden Richtlinien wahrscheinlich noch lauter werden – und jetzt ist der richtige Zeitpunkt, um vorauszugehen.